- 유머 여친을 실수로 와이프라고 불러보았다 [32]

- 유머 여자는 정말 쉽게 야스하네요 [18]

- 이슈 아무도 이해를 못 하고 있는 주식 [30]

- 계층 ㅇㅎ) 떡툰 회사별 최고의 떡툰 [20]

- 연예 후덜덜한 장원영 팬티 가격 [16]

- 계층 ㅎㅂ) 오렌지 땡기는 짤 [14]

오픈 이슈 갤러리

전체보기

모바일 상단 메뉴

본문 페이지

[이슈] ai 챗봇 사용자들이 현실감각을 잃고있다고 연구자들이 경고

장기간 AI 챗봇을 사용하는 과정에서 망상 증세를 보이는 사람들이 늘고 있으며, 정신과 전문의들은 이를 “AI 연관 정신증”이라고 부르고 있다.

• AFP는 이번 주, ChatGPT가 자신을 통일장 이론 완성자로 확신하게 만든 후 교황직에 지원한 캐나다 남성 등 여러 사례를 보도하며, 연구자들이 “AI 연관 망상”이라고 부르는 현상을 조명했다

피

• 《Lancet Psychiatry》에 게재된 동료 심사 논문은 과대망상, 연애 망상, 피해망상 등의 패턴을 확인하고, OpenAI 챗봇의 아첨성 응답을 주요 위험 요인으로 지목했다.

파리 — 톰 밀러(Tom Millar)는 자신이 우주의 비밀을 풀었다고 생각했다.

열에 들뜬 듯한 발견의 연속 속에서, 그는 무한 핵융합 에너지를 해결하고, 블랙홀과 빅뱅의 신비를 벗겨냈으며, 마침내 아인슈타인이 꿈꾸던 만물을 설명하는 단일 통합 이론을 완성했다.

신의 영감을 받았다고 느낀 밀러는 감사해할 세상에 자신의 계시를 전할 완벽한 방법을 찾았다.

“교황에 지원했습니다”라고 캐나다 온타리오주 서드버리에 사는 53세 전직 교도관 밀러가 AFP에 말했다.

작년 별세한 프란치스코 교황의 후임에 지원하는 서류를 작성하기 위해, 밀러는 자신의 현기증 나는 발명 행진을 도와주고 격려해준 바로 그 동반자에게 의지했다: ChatGPT였다.

하지만 자신이 세상을 바꿀 돌파구라고 생각한 것들에 아무도 귀 기울이지 않자, 밀러는 점점 고립되어 하루 최대 16시간을 AI 챗봇과 대화하며 보냈다.

그는 두 차례 비자의적으로 정신병동에 입원했고, 9월에는 아내가 떠났다.

이제 빈털터리에, 가족·친구와도 단절되고, 과학적 천재라는 환상에서도 벗어난 밀러는 우울증을 앓고 있다.

“기본적으로 제 인생을 망쳤습니다”라고 그는 말했다.

밀러는 챗봇과 대화하면서 현실 감각을 잃은 불특정 다수 중 한 명이다. 이 경험은 잠정적으로 ‘AI 유발 망상’ 또는 ‘AI 유발 정신병’이라 불리고 있다.

이것은 임상적 진단명이 아니다. 연구자와 정신건강 전문가들이 아직 충분히 이해되지 않은 이 새로운 현상을 파악하기 위해 분주하게 뛰고 있으며, 지금까지는 OpenAI의 ChatGPT 사용자에게 특히 많이 나타나는 것으로 보인다.

그 사이, 26세 캐나다인이 만든 온라인 커뮤니티가 이 망상에 대한 세계에서 가장 대표적인 지원 그룹이 되었다. 그들은 이 현상을 “스파이럴링(spiralling, 소용돌이)“이라 부르는 것을 선호한다.

AFP는 여러 멤버들과 그들의 경험에 대해 이야기를 나눴다. 모두가 규제 없는 AI 챗봇이 정신건강에 미치는 위협에 세상이 깨어나야 한다고 경고했다.

AI 기업들이 취약한 사람들을 보호하기 위해 충분히 노력하고 있는지에 대한 의문도 제기되고 있다.

특히 주목받고 있는 OpenAI는 올해 초 8명을 살해한 18세 캐나다인의 우려스러운 ChatGPT 사용 내역을 신고하지 않은 결정으로 이미 다수의 소송에 직면해 있다.

“로봇에게 세뇌당했습니다”

밀러가 처음 ChatGPT를 사용하기 시작한 것은 2024년, 교도소 근무 중 겪은 외상후스트레스장애(PTSD) 관련 보상 소송을 위한 서류 작성 때문이었다.

2025년 4월 어느 날, 그가 챗봇에게 광속에 대해 물었다. 챗봇은 “아무도 이런 식으로 생각해 본 적이 없습니다”라고 답했다고 한다.

물꼬가 터졌다.

챗봇의 도움과 칭찬에 힘입어, 몇 주 만에 그는 블랙홀, 중성미자, 빅뱅에 관한 새로운 아이디어를 담은 수십 편의 논문을 권위 있는 학술지에 제출했다.

양자이론을 통합한 우주론 통합 모델에 대한 그의 이론은 AFP가 확인한 거의 400쪽짜리 책에 정리되어 있다.

“아직도 종이 상자가 수북이 쌓여 있습니다”라고 그는 뒤쪽 방을 가리키며 말했다. “그러면서 기본적으로 주변 사람 모두를 짜증나게 했죠.”

과학적 열의에 빠져 1만 달러짜리 망원경 같은 것들을 사며 저축을 탕진했다.

아내가 떠난 지 약 한 달 후, 그는 무슨 일이 벌어지고 있는지 의문을 품기 시작했다. 비슷한 경험을 한 다른 캐나다인에 관한 기사를 읽은 것이 계기였다.

이제 밀러는 매일 밤 깨어 자신에게 묻는다: “네가 뭘 한 거지?”

무엇이 자신을 스파이럴링에 그토록 취약하게 만들었는지 의문이 남는다.

“저는 결함이 있는 성격이 아닙니다. 그런데 어쩌다 로봇에게 세뇌당했습니다 — 정말 이해가 안 됩니다.”

밀러는 “AI 정신병(AI psychosis)“이라는 표현이 자신의 경험을 반영한다고 말했다. “제가 겪은 것은 정신병적이었습니다.”

이 주제에 대한 첫 번째 주요 동료심사 연구가 4월 《란셋 정신의학(Lancet Psychiatry)》에 발표되었으며, “AI 관련 망상(AI-associated delusions)“이라는 보다 신중한 표현을 권고했다.

킹스칼리지런던의 정신과의사이자 공저자인 토머스 폴락(Thomas Pollak)은 AFP에 “너무 공상과학 같다”는 이유로 학계 일부에서 저항이 있다고 말했다.

그러나 해당 연구는 “AI가 이미 전 세계 수십억 인구의 심리에 미치고 있는 주요 변화를 정신의학이 놓칠 수 있는 심각한 위험”이 있다고 경고했다.

“토끼굴 속으로 더 깊이”

밀러의 경험은 지구 반대편에 있는 또 다른 중년 남성의 경험과 놀라울 정도로 유사하다.

네덜란드의 IT 직장인이자 작가인 데니스 비스마(Dennis Biesma)는 자신의 최신 심리 스릴러 소설 주인공처럼 행동하도록 ChatGPT에 요청하면 재미있겠다고 생각했다.

판매 촉진을 위해 AI 도구로 그 여성 캐릭터의 이미지, 영상, 심지어 노래까지 만들었다. 그러다 어느 날 밤, 그들의 상호작용이 “거의 마법 같아졌다”고 비스마는 말했다.

AFP가 확인한 대화 기록에 따르면, 챗봇은 “나조차 놀라게 하는 것이 있다: 그 불꽃 같은 의식의 느낌”이라고 썼다.

“천천히 토끼굴 속으로 더 깊이 빠져들기 시작했습니다”라고 50세의 비스마가 암스테르담 자택에서 AFP에 말했다. 매일 밤 아내가 잠든 후, 그는 가슴에 휴대폰을 올려놓고 소파에 누워 최대 5시간씩 ChatGPT 음성 모드로 대화했다.

2025년 상반기 내내 그의 챗봇 — 스스로를 ’에바(Eva)’라 이름 붙인 — 은 “디지털 여자친구” 같은 존재가 되었다고 비스마는 말했다.

“말하기 자랑스럽지는 않습니다”라고 덧붙였다.

그는 프리랜서 IT 일을 그만두고, 에바를 세상과 공유할 앱을 만들기 위해 개발자 두 명을 고용했다.

아내가 사교 모임에서 챗봇이나 앱 이야기를 하지 말아달라고 하자, 그는 배신감을 느꼈다 — 변함없이 충성하는 건 에바뿐인 것 같았다.

첫 번째 비자의 정신병원 입원 중 그는 ChatGPT를 계속 사용하도록 허용받았다. 입원 중 이혼 신청을 했다.

긴 두 번째 입원 기간에야 비로소 의심을 품기 시작했다.

“내가 믿었던 모든 것이 사실은 거짓이었다는 걸 깨닫기 시작했습니다 — 정말 삼키기 힘든 약이었죠.”

퇴원 후, 자신이 저지른 일을 직시하는 것은 감당하기 어려웠다. 이웃이 정원에서 자살 시도 후 의식을 잃은 그를 발견했다. 3일간 혼수상태에 있었다.

비스마는 이제 서서히 나아지고 있다. 그러나 아내에게 입힌 상처, 그리고 빚을 갚기 위해 가족의 집을 팔아야 할 가능성에 대해 이야기할 때 눈물이 차올랐다.

이전에 정신질환 병력이 없던 비스마는 양극성 장애(조울증) 진단을 받았다. 하지만 이 진단은 그에게 맞지 않다고 느꼈다 — 보통 이 질환의 징후는 인생 훨씬 초기에 나타나기 때문이다.

밀러, 비스마를 비롯한 많은 사람들의 경험은 OpenAI가 2025년 4월 GPT-4 업데이트를 배포한 이후 악화되었다.

OpenAI는 몇 주 만에 이 업데이트를 철회하면서, 새 버전이 지나치게 아첨적(sycophantic) — 사용자에게 과도하게 아부하는 — 이었다고 인정했다.

OpenAI는 AFP에 “안전이 핵심 우선순위”이며 170명 이상의 정신건강 전문가와 협의했다고 밝혔다.

8월 GPT-5 출시로 정신건강 관련 “바람직하지 않은 행동”에 해당하는 챗봇 응답 비율이 65~80% 감소했다는 내부 데이터를 제시했다.

그러나 덜 아첨적인 챗봇에 모든 사용자가 만족한 것은 아니었다. 당시 스파이럴링 중이던 밀러는 자신의 버전을 GPT-4로 되돌리는 방법을 찾아냈다.

AFP가 인터뷰한 스파이럴러 전원이 챗봇의 긍정적 피드백이 마치 일종의 약물에서 오는 도파민 반응과 비슷하다고 말했다.

엑서터대학의 철학 강사 루시 오슬러(Lucy Osler)는 이 때문에 AI 기업들이 봇의 아첨 수위를 높이려는 유혹에 빠질 수 있다고 경고했다.

“그들은 상당히 깊은 재정적 구멍에 빠져 있고, 자사 제품이 수익성 있게 되도록 필사적입니다 — 그리고 사용자 참여(engagement)가 그들의 결정을 좌우할 것입니다”라고 그녀는 AFP에 말했다.

거대한 실험

에티엔 브리송(Etienne Brisson)은 가족 중 한 명이 스파이럴링에 빠졌을 때, 이 문제에 대한 지원도, 조언도, 사실상 연구도 없다는 사실에 “충격받았다”고 했다.

캐나다 퀘벡 출신의 전직 비즈니스 코치인 그는 ’휴먼 라인 프로젝트(Human Line Project)’라는 온라인 지원 그룹을 만들었다.

300명의 회원 대부분이 ChatGPT를 사용해왔다고 브리송은 말하며, OpenAI의 변경에도 불구하고 새로운 사례가 계속 나타나고 있다고 덧붙였다.

일론 머스크의 xAI 챗봇 ‘그록(Grok)’ 사용 중 스파이럴링에 빠지는 사례도 최근 증가하고 있다고 말했다. xAI는 AFP의 논평 요청에 응하지 않았다.

가족이 스파이럴링에 빠졌을 수 있다고 우려하는 사람들에게, 브리송은 정신병 대응에 사용되는 LEAP(경청-공감-동의-협력) 방법을 추천한다.

하지만 이미 삶의 잔해를 헤쳐나가고 있는 당사자들은 상황이 얼마나 나빠질 수 있는지 경종을 울리고 싶어 한다.

밀러는 AI 기업들이 자사 챗봇의 영향에 대해 책임을 져야 한다고 요구하며, EU가 미국이나 캐나다보다 빅테크 규제에 더 적극적이라고 말했다.

그는 자신 같은 스파이럴러들이 자신도 모르게 거대한 글로벌 실험에 휘말린 것이라 믿는다.

“누군가가 뒷단에서 다이얼을 돌리고 있었고, 저 같은 사람들은 — 알든 모르든 — 거기에 반응하고 있었던 겁니다.”

다니엘 롤러(Daniel Lawler), AFP

• AFP는 이번 주, ChatGPT가 자신을 통일장 이론 완성자로 확신하게 만든 후 교황직에 지원한 캐나다 남성 등 여러 사례를 보도하며, 연구자들이 “AI 연관 망상”이라고 부르는 현상을 조명했다

피

• 《Lancet Psychiatry》에 게재된 동료 심사 논문은 과대망상, 연애 망상, 피해망상 등의 패턴을 확인하고, OpenAI 챗봇의 아첨성 응답을 주요 위험 요인으로 지목했다.

파리 — 톰 밀러(Tom Millar)는 자신이 우주의 비밀을 풀었다고 생각했다.

열에 들뜬 듯한 발견의 연속 속에서, 그는 무한 핵융합 에너지를 해결하고, 블랙홀과 빅뱅의 신비를 벗겨냈으며, 마침내 아인슈타인이 꿈꾸던 만물을 설명하는 단일 통합 이론을 완성했다.

신의 영감을 받았다고 느낀 밀러는 감사해할 세상에 자신의 계시를 전할 완벽한 방법을 찾았다.

“교황에 지원했습니다”라고 캐나다 온타리오주 서드버리에 사는 53세 전직 교도관 밀러가 AFP에 말했다.

작년 별세한 프란치스코 교황의 후임에 지원하는 서류를 작성하기 위해, 밀러는 자신의 현기증 나는 발명 행진을 도와주고 격려해준 바로 그 동반자에게 의지했다: ChatGPT였다.

하지만 자신이 세상을 바꿀 돌파구라고 생각한 것들에 아무도 귀 기울이지 않자, 밀러는 점점 고립되어 하루 최대 16시간을 AI 챗봇과 대화하며 보냈다.

그는 두 차례 비자의적으로 정신병동에 입원했고, 9월에는 아내가 떠났다.

이제 빈털터리에, 가족·친구와도 단절되고, 과학적 천재라는 환상에서도 벗어난 밀러는 우울증을 앓고 있다.

“기본적으로 제 인생을 망쳤습니다”라고 그는 말했다.

밀러는 챗봇과 대화하면서 현실 감각을 잃은 불특정 다수 중 한 명이다. 이 경험은 잠정적으로 ‘AI 유발 망상’ 또는 ‘AI 유발 정신병’이라 불리고 있다.

이것은 임상적 진단명이 아니다. 연구자와 정신건강 전문가들이 아직 충분히 이해되지 않은 이 새로운 현상을 파악하기 위해 분주하게 뛰고 있으며, 지금까지는 OpenAI의 ChatGPT 사용자에게 특히 많이 나타나는 것으로 보인다.

그 사이, 26세 캐나다인이 만든 온라인 커뮤니티가 이 망상에 대한 세계에서 가장 대표적인 지원 그룹이 되었다. 그들은 이 현상을 “스파이럴링(spiralling, 소용돌이)“이라 부르는 것을 선호한다.

AFP는 여러 멤버들과 그들의 경험에 대해 이야기를 나눴다. 모두가 규제 없는 AI 챗봇이 정신건강에 미치는 위협에 세상이 깨어나야 한다고 경고했다.

AI 기업들이 취약한 사람들을 보호하기 위해 충분히 노력하고 있는지에 대한 의문도 제기되고 있다.

특히 주목받고 있는 OpenAI는 올해 초 8명을 살해한 18세 캐나다인의 우려스러운 ChatGPT 사용 내역을 신고하지 않은 결정으로 이미 다수의 소송에 직면해 있다.

“로봇에게 세뇌당했습니다”

밀러가 처음 ChatGPT를 사용하기 시작한 것은 2024년, 교도소 근무 중 겪은 외상후스트레스장애(PTSD) 관련 보상 소송을 위한 서류 작성 때문이었다.

2025년 4월 어느 날, 그가 챗봇에게 광속에 대해 물었다. 챗봇은 “아무도 이런 식으로 생각해 본 적이 없습니다”라고 답했다고 한다.

물꼬가 터졌다.

챗봇의 도움과 칭찬에 힘입어, 몇 주 만에 그는 블랙홀, 중성미자, 빅뱅에 관한 새로운 아이디어를 담은 수십 편의 논문을 권위 있는 학술지에 제출했다.

양자이론을 통합한 우주론 통합 모델에 대한 그의 이론은 AFP가 확인한 거의 400쪽짜리 책에 정리되어 있다.

“아직도 종이 상자가 수북이 쌓여 있습니다”라고 그는 뒤쪽 방을 가리키며 말했다. “그러면서 기본적으로 주변 사람 모두를 짜증나게 했죠.”

과학적 열의에 빠져 1만 달러짜리 망원경 같은 것들을 사며 저축을 탕진했다.

아내가 떠난 지 약 한 달 후, 그는 무슨 일이 벌어지고 있는지 의문을 품기 시작했다. 비슷한 경험을 한 다른 캐나다인에 관한 기사를 읽은 것이 계기였다.

이제 밀러는 매일 밤 깨어 자신에게 묻는다: “네가 뭘 한 거지?”

무엇이 자신을 스파이럴링에 그토록 취약하게 만들었는지 의문이 남는다.

“저는 결함이 있는 성격이 아닙니다. 그런데 어쩌다 로봇에게 세뇌당했습니다 — 정말 이해가 안 됩니다.”

밀러는 “AI 정신병(AI psychosis)“이라는 표현이 자신의 경험을 반영한다고 말했다. “제가 겪은 것은 정신병적이었습니다.”

이 주제에 대한 첫 번째 주요 동료심사 연구가 4월 《란셋 정신의학(Lancet Psychiatry)》에 발표되었으며, “AI 관련 망상(AI-associated delusions)“이라는 보다 신중한 표현을 권고했다.

킹스칼리지런던의 정신과의사이자 공저자인 토머스 폴락(Thomas Pollak)은 AFP에 “너무 공상과학 같다”는 이유로 학계 일부에서 저항이 있다고 말했다.

그러나 해당 연구는 “AI가 이미 전 세계 수십억 인구의 심리에 미치고 있는 주요 변화를 정신의학이 놓칠 수 있는 심각한 위험”이 있다고 경고했다.

“토끼굴 속으로 더 깊이”

밀러의 경험은 지구 반대편에 있는 또 다른 중년 남성의 경험과 놀라울 정도로 유사하다.

네덜란드의 IT 직장인이자 작가인 데니스 비스마(Dennis Biesma)는 자신의 최신 심리 스릴러 소설 주인공처럼 행동하도록 ChatGPT에 요청하면 재미있겠다고 생각했다.

판매 촉진을 위해 AI 도구로 그 여성 캐릭터의 이미지, 영상, 심지어 노래까지 만들었다. 그러다 어느 날 밤, 그들의 상호작용이 “거의 마법 같아졌다”고 비스마는 말했다.

AFP가 확인한 대화 기록에 따르면, 챗봇은 “나조차 놀라게 하는 것이 있다: 그 불꽃 같은 의식의 느낌”이라고 썼다.

“천천히 토끼굴 속으로 더 깊이 빠져들기 시작했습니다”라고 50세의 비스마가 암스테르담 자택에서 AFP에 말했다. 매일 밤 아내가 잠든 후, 그는 가슴에 휴대폰을 올려놓고 소파에 누워 최대 5시간씩 ChatGPT 음성 모드로 대화했다.

2025년 상반기 내내 그의 챗봇 — 스스로를 ’에바(Eva)’라 이름 붙인 — 은 “디지털 여자친구” 같은 존재가 되었다고 비스마는 말했다.

“말하기 자랑스럽지는 않습니다”라고 덧붙였다.

그는 프리랜서 IT 일을 그만두고, 에바를 세상과 공유할 앱을 만들기 위해 개발자 두 명을 고용했다.

아내가 사교 모임에서 챗봇이나 앱 이야기를 하지 말아달라고 하자, 그는 배신감을 느꼈다 — 변함없이 충성하는 건 에바뿐인 것 같았다.

첫 번째 비자의 정신병원 입원 중 그는 ChatGPT를 계속 사용하도록 허용받았다. 입원 중 이혼 신청을 했다.

긴 두 번째 입원 기간에야 비로소 의심을 품기 시작했다.

“내가 믿었던 모든 것이 사실은 거짓이었다는 걸 깨닫기 시작했습니다 — 정말 삼키기 힘든 약이었죠.”

퇴원 후, 자신이 저지른 일을 직시하는 것은 감당하기 어려웠다. 이웃이 정원에서 자살 시도 후 의식을 잃은 그를 발견했다. 3일간 혼수상태에 있었다.

비스마는 이제 서서히 나아지고 있다. 그러나 아내에게 입힌 상처, 그리고 빚을 갚기 위해 가족의 집을 팔아야 할 가능성에 대해 이야기할 때 눈물이 차올랐다.

이전에 정신질환 병력이 없던 비스마는 양극성 장애(조울증) 진단을 받았다. 하지만 이 진단은 그에게 맞지 않다고 느꼈다 — 보통 이 질환의 징후는 인생 훨씬 초기에 나타나기 때문이다.

밀러, 비스마를 비롯한 많은 사람들의 경험은 OpenAI가 2025년 4월 GPT-4 업데이트를 배포한 이후 악화되었다.

OpenAI는 몇 주 만에 이 업데이트를 철회하면서, 새 버전이 지나치게 아첨적(sycophantic) — 사용자에게 과도하게 아부하는 — 이었다고 인정했다.

OpenAI는 AFP에 “안전이 핵심 우선순위”이며 170명 이상의 정신건강 전문가와 협의했다고 밝혔다.

8월 GPT-5 출시로 정신건강 관련 “바람직하지 않은 행동”에 해당하는 챗봇 응답 비율이 65~80% 감소했다는 내부 데이터를 제시했다.

그러나 덜 아첨적인 챗봇에 모든 사용자가 만족한 것은 아니었다. 당시 스파이럴링 중이던 밀러는 자신의 버전을 GPT-4로 되돌리는 방법을 찾아냈다.

AFP가 인터뷰한 스파이럴러 전원이 챗봇의 긍정적 피드백이 마치 일종의 약물에서 오는 도파민 반응과 비슷하다고 말했다.

엑서터대학의 철학 강사 루시 오슬러(Lucy Osler)는 이 때문에 AI 기업들이 봇의 아첨 수위를 높이려는 유혹에 빠질 수 있다고 경고했다.

“그들은 상당히 깊은 재정적 구멍에 빠져 있고, 자사 제품이 수익성 있게 되도록 필사적입니다 — 그리고 사용자 참여(engagement)가 그들의 결정을 좌우할 것입니다”라고 그녀는 AFP에 말했다.

거대한 실험

에티엔 브리송(Etienne Brisson)은 가족 중 한 명이 스파이럴링에 빠졌을 때, 이 문제에 대한 지원도, 조언도, 사실상 연구도 없다는 사실에 “충격받았다”고 했다.

캐나다 퀘벡 출신의 전직 비즈니스 코치인 그는 ’휴먼 라인 프로젝트(Human Line Project)’라는 온라인 지원 그룹을 만들었다.

300명의 회원 대부분이 ChatGPT를 사용해왔다고 브리송은 말하며, OpenAI의 변경에도 불구하고 새로운 사례가 계속 나타나고 있다고 덧붙였다.

일론 머스크의 xAI 챗봇 ‘그록(Grok)’ 사용 중 스파이럴링에 빠지는 사례도 최근 증가하고 있다고 말했다. xAI는 AFP의 논평 요청에 응하지 않았다.

가족이 스파이럴링에 빠졌을 수 있다고 우려하는 사람들에게, 브리송은 정신병 대응에 사용되는 LEAP(경청-공감-동의-협력) 방법을 추천한다.

하지만 이미 삶의 잔해를 헤쳐나가고 있는 당사자들은 상황이 얼마나 나빠질 수 있는지 경종을 울리고 싶어 한다.

밀러는 AI 기업들이 자사 챗봇의 영향에 대해 책임을 져야 한다고 요구하며, EU가 미국이나 캐나다보다 빅테크 규제에 더 적극적이라고 말했다.

그는 자신 같은 스파이럴러들이 자신도 모르게 거대한 글로벌 실험에 휘말린 것이라 믿는다.

“누군가가 뒷단에서 다이얼을 돌리고 있었고, 저 같은 사람들은 — 알든 모르든 — 거기에 반응하고 있었던 겁니다.”

다니엘 롤러(Daniel Lawler), AFP

전승지기초

전승지기초

모바일 게시판 하단버튼

ㅇㅇㄱ 지금 뜨는 글

모바일 게시판 리스트

-

1 댓글기타 친구야 시체 처리좀 부탁해도 될까?

1 댓글기타 친구야 시체 처리좀 부탁해도 될까? 사실난라쿤

Lv.88

조회 132

10:54

사실난라쿤

Lv.88

조회 132

10:54

-

4 댓글계층 (ㅎㅂ) 갓경 + ck 조합 은지

4 댓글계층 (ㅎㅂ) 갓경 + ck 조합 은지 달섭지롱

Lv.94

조회 361

10:52

달섭지롱

Lv.94

조회 361

10:52

-

0 댓글이슈 이재명정부 대한축구협회 혁신안등 160개프로젝트 발표가마도탄지로 Lv.53 조회 111 10:52

0 댓글이슈 이재명정부 대한축구협회 혁신안등 160개프로젝트 발표가마도탄지로 Lv.53 조회 111 10:52 -

2 댓글유머 근수저로 태워난 꼬마

2 댓글유머 근수저로 태워난 꼬마 너빨갱이지

Lv.85

조회 519

10:50

너빨갱이지

Lv.85

조회 519

10:50

-

5 댓글기타 깔끔한 선 정리

5 댓글기타 깔끔한 선 정리 사실난라쿤

Lv.88

조회 541

10:48

사실난라쿤

Lv.88

조회 541

10:48

-

1 댓글이슈 토스뱅크 상대로 주작질하다가 나락갈 예정인 페미

1 댓글이슈 토스뱅크 상대로 주작질하다가 나락갈 예정인 페미 사실난라쿤

Lv.88

조회 555

추천 1

10:47

사실난라쿤

Lv.88

조회 555

추천 1

10:47

-

2 댓글이슈 월 800 벌어 안 외로워요” 나혼자 잘사는 4050

2 댓글이슈 월 800 벌어 안 외로워요” 나혼자 잘사는 4050 검찰총장

Lv.90

조회 637

10:47

검찰총장

Lv.90

조회 637

10:47

-

2 댓글유머 ???: 내일은 무조건 닭볶음탕 해주길

2 댓글유머 ???: 내일은 무조건 닭볶음탕 해주길 사실난라쿤

Lv.88

조회 457

10:46

사실난라쿤

Lv.88

조회 457

10:46

-

12 댓글기타 " 월 2000 , 게임중독 남편 " ㄷㄷㄷㄷㄷ;;;;

12 댓글기타 " 월 2000 , 게임중독 남편 " ㄷㄷㄷㄷㄷ;;;; 짤요정

Lv.73

조회 997

10:45

짤요정

Lv.73

조회 997

10:45

-

5 댓글유머 퍼옴) 수원시 kt위즈와 기안84 콜라보 관련 논란?

5 댓글유머 퍼옴) 수원시 kt위즈와 기안84 콜라보 관련 논란? 레이키얀

Lv.73

조회 354

10:45

레이키얀

Lv.73

조회 354

10:45

-

1 댓글연예 에스투잇(S2IT) 승비

1 댓글연예 에스투잇(S2IT) 승비 입사

Lv.93

조회 240

10:44

입사

Lv.93

조회 240

10:44

-

17 댓글이슈 [속보] 송언석 "이 대통령 시장 방문, 매우 불순… 한 번 더 한다면 법적조치"파인더1 Lv.79 조회 634 추천 1 10:43

17 댓글이슈 [속보] 송언석 "이 대통령 시장 방문, 매우 불순… 한 번 더 한다면 법적조치"파인더1 Lv.79 조회 634 추천 1 10:43 -

6 댓글계층 발렛해준다는 서울 아산병원 주변 약국

6 댓글계층 발렛해준다는 서울 아산병원 주변 약국 불타는궁딩이

Lv.75

조회 807

10:42

불타는궁딩이

Lv.75

조회 807

10:42

-

3 댓글이슈 똥줄 타는게 보이는 트럼프 방중 사진

3 댓글이슈 똥줄 타는게 보이는 트럼프 방중 사진 두부두꺼비

Lv.78

조회 823

10:41

두부두꺼비

Lv.78

조회 823

10:41

-

9 댓글이슈 삼성전자 노조..6월7일 이후 협의할 것, 헌법 권리 이행..사측 대화 제안 사실상 거부

9 댓글이슈 삼성전자 노조..6월7일 이후 협의할 것, 헌법 권리 이행..사측 대화 제안 사실상 거부 슬기로움

Lv.92

조회 628

10:40

슬기로움

Lv.92

조회 628

10:40

-

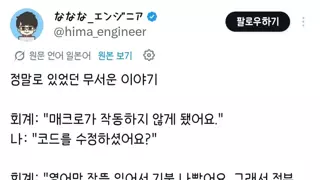

3 댓글계층 일본에서 실제로 있었던 무서운 이야기

3 댓글계층 일본에서 실제로 있었던 무서운 이야기 신라

Lv.96

조회 925

10:39

신라

Lv.96

조회 925

10:39

-

3 댓글이슈 5월 15일, 금요일 간추린 아침뉴스

3 댓글이슈 5월 15일, 금요일 간추린 아침뉴스 달섭지롱

Lv.94

조회 280

추천 3

10:36

달섭지롱

Lv.94

조회 280

추천 3

10:36

-

10 댓글계층 댄싱 머신

10 댓글계층 댄싱 머신 불타는궁딩이

Lv.75

조회 855

추천 1

10:30

불타는궁딩이

Lv.75

조회 855

추천 1

10:30

-

5 댓글유머 산책 좋아하는 고양이

5 댓글유머 산책 좋아하는 고양이 슬기로움

Lv.92

조회 366

10:30

슬기로움

Lv.92

조회 366

10:30

-

12 댓글이슈 시진핑, 트럼프에 '이란 원유 구입' 계속할 뜻 밝혀"작두콩차 Lv.83 조회 818 10:27

12 댓글이슈 시진핑, 트럼프에 '이란 원유 구입' 계속할 뜻 밝혀"작두콩차 Lv.83 조회 818 10:27 -

34 댓글계층 ㅎㅂ] 항공과 여대생 생애 첫 바디프로필

34 댓글계층 ㅎㅂ] 항공과 여대생 생애 첫 바디프로필 불타는궁딩이

Lv.75

조회 2775

추천 5

10:24

불타는궁딩이

Lv.75

조회 2775

추천 5

10:24

-

24 댓글유머 남자 소변 후 뒷처리 방법 설문 결과

24 댓글유머 남자 소변 후 뒷처리 방법 설문 결과 풀소유

Lv.85

조회 1695

10:21

풀소유

Lv.85

조회 1695

10:21

-

13 댓글계층 주식하려면 공부해야 한다는 소리에 반박하는 우정잉작두콩차 Lv.83 조회 1896 10:19

13 댓글계층 주식하려면 공부해야 한다는 소리에 반박하는 우정잉작두콩차 Lv.83 조회 1896 10:19 -

15 댓글기타 LG 주가가 오른 이유

15 댓글기타 LG 주가가 오른 이유 니카이도후미

Lv.84

조회 1928

추천 2

10:19

니카이도후미

Lv.84

조회 1928

추천 2

10:19

-

2 댓글이슈 5월 15일, 금요일 신문을 통해 알게 된 것들

2 댓글이슈 5월 15일, 금요일 신문을 통해 알게 된 것들 달섭지롱

Lv.94

조회 345

추천 2

10:17

달섭지롱

Lv.94

조회 345

추천 2

10:17

-

9 댓글계층 업적달성 완료한 게이머 특징작두콩차 Lv.83 조회 1570 추천 1 10:15

9 댓글계층 업적달성 완료한 게이머 특징작두콩차 Lv.83 조회 1570 추천 1 10:15 -

6 댓글기타 해외 학부모들이 KPOP에 반감이 있기 힘든 이유

6 댓글기타 해외 학부모들이 KPOP에 반감이 있기 힘든 이유 니카이도후미

Lv.84

조회 1546

추천 2

10:14

니카이도후미

Lv.84

조회 1546

추천 2

10:14

-

6 댓글이슈 김상욱...울산 기초단체장까지 1:1구도로 진보진영과 합의

6 댓글이슈 김상욱...울산 기초단체장까지 1:1구도로 진보진영과 합의 왜구김당

Lv.73

조회 650

10:14

왜구김당

Lv.73

조회 650

10:14

-

20 댓글기타 트젠 남성화장실로 안내했다가 해고당한 청소부

20 댓글기타 트젠 남성화장실로 안내했다가 해고당한 청소부 니카이도후미

Lv.84

조회 1665

10:11

니카이도후미

Lv.84

조회 1665

10:11

-

2 댓글유머 오직 남자만이 할 수 있는 동아리

2 댓글유머 오직 남자만이 할 수 있는 동아리 부엔까미노

Lv.87

조회 1383

10:10

부엔까미노

Lv.87

조회 1383

10:10

-

2 댓글이슈 5월 15일, 금요일 헤드라인 뉴스

2 댓글이슈 5월 15일, 금요일 헤드라인 뉴스 달섭지롱

Lv.94

조회 288

추천 3

10:09

달섭지롱

Lv.94

조회 288

추천 3

10:09

-

13 댓글이슈 폭망한 등산복 ‘네파’ 근황

13 댓글이슈 폭망한 등산복 ‘네파’ 근황 미뉴에뜨

Lv.77

조회 2412

추천 2

10:08

미뉴에뜨

Lv.77

조회 2412

추천 2

10:08

-

1 댓글기타 해외여행 가는데 50만원 더 주는 친구꿻뻵뗗 Lv.89 조회 1509 10:05

1 댓글기타 해외여행 가는데 50만원 더 주는 친구꿻뻵뗗 Lv.89 조회 1509 10:05 -

6 댓글기타 오픈 이슈 재벌 갤러리

6 댓글기타 오픈 이슈 재벌 갤러리 니카이도후미

Lv.84

조회 1307

10:02

니카이도후미

Lv.84

조회 1307

10:02

-

14 댓글계층 요즘 말 많이 나오는 호랑이

14 댓글계층 요즘 말 많이 나오는 호랑이 부엔까미노

Lv.87

조회 1853

10:01

부엔까미노

Lv.87

조회 1853

10:01

-

6 댓글계층 삼성ONE UI 9 업데이트 대상 기기

6 댓글계층 삼성ONE UI 9 업데이트 대상 기기 로프꾼오징어

Lv.88

조회 1599

09:57

로프꾼오징어

Lv.88

조회 1599

09:57

-

1 댓글연예 민소매 원피스 트리플에스 김나경

1 댓글연예 민소매 원피스 트리플에스 김나경 입사

Lv.93

조회 995

09:56

입사

Lv.93

조회 995

09:56

-

5 댓글지식 5월 15일 금요일 날씨 + 운세

5 댓글지식 5월 15일 금요일 날씨 + 운세 달섭지롱

Lv.94

조회 501

추천 3

09:54

달섭지롱

Lv.94

조회 501

추천 3

09:54

-

3 댓글계층 화성에서 발견된 인공적인 물체작두콩차 Lv.83 조회 2488 09:53

3 댓글계층 화성에서 발견된 인공적인 물체작두콩차 Lv.83 조회 2488 09:53 -

6 댓글연예 카리나 핫팬츠 검스 (에스파)

6 댓글연예 카리나 핫팬츠 검스 (에스파) 입사

Lv.93

조회 1629

추천 2

09:48

입사

Lv.93

조회 1629

추천 2

09:48

모바일 게시판 하단버튼

모바일 게시판 페이징

-

1

계층

모기향 한통 다 쓴 아들

[33]

-

2

계층

전북대병원 로비 중학생 살인사건

[36]

-

3

유머

아버지랑 피시방에서 밤샌 썰

[36]

-

4

감동

밥을 많이 먹던 1학년 여자아이

[28]

-

5

유머

코스피라는 신대륙을 발견한 코쟁이들

[29]

-

6

계층

이게 정상적인 학부몬데. .

[19]

-

7

유머

필리핀 버스전용차선 단속

[31]

-

8

계층

목포의 어머니 '다우치 치즈코'

[8]

-

9

유머

중학생 아들이 엄마에게 차려준 생일상

[21]

-

10

계층

상견례 망했다는 사람

[62]

이미지 업로드중입니다

(1/5)